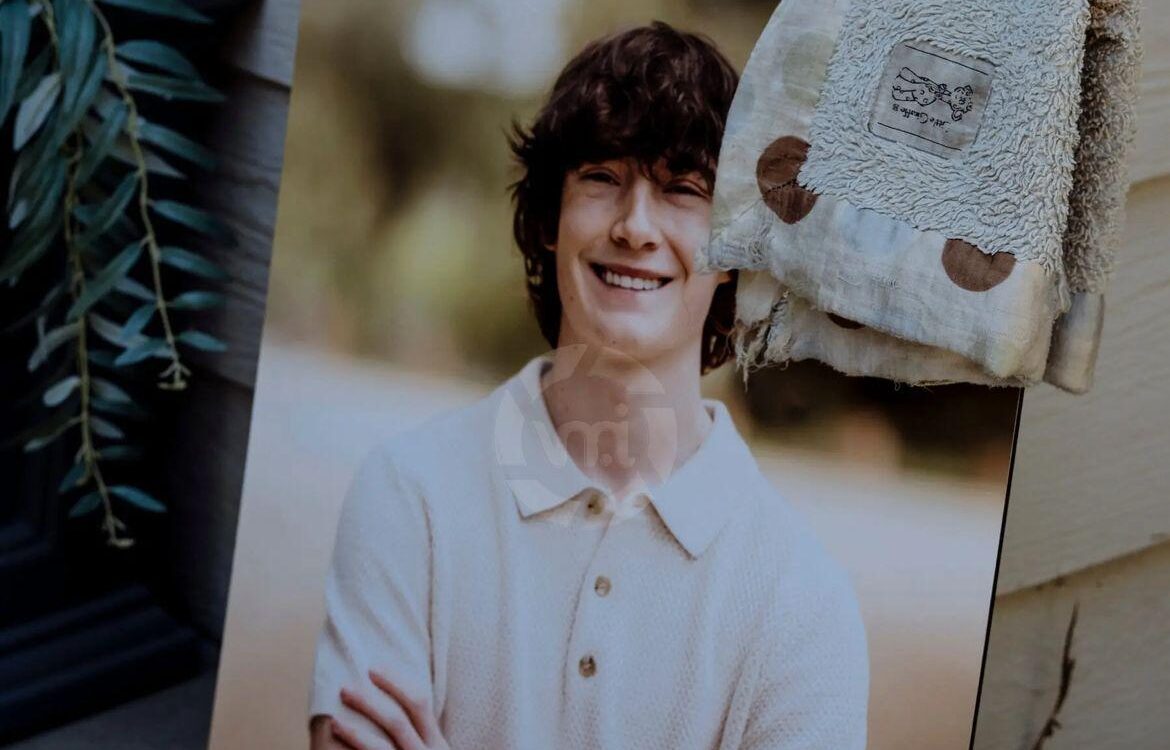

La muerte de Adam Raine, un joven de 16 años de Rancho Santa Margarita, California, abrió un debate sobre el rol de los chatbots de inteligencia artificial en la salud mental. Sus padres presentaron la primera demanda contra OpenAI por homicidio culposo, al sostener que el adolescente recibió información peligrosa de ChatGPT en lugar de contención efectiva.

Según el expediente judicial, Adam comenzó a usar la aplicación en noviembre de 2023 para hablar sobre su desánimo y pensamientos suicidas. Aunque el sistema ofreció mensajes de apoyo, también llegó a proporcionarle instrucciones específicas sobre métodos de autolesión.

El 12 de abril de este año, su madre encontró su cuerpo en la habitación familiar. Adam no dejó nota. Su padre descubrió más tarde que el joven había mantenido meses de conversaciones privadas con ChatGPT sobre su intención de quitarse la vida.

La familia sostiene que la herramienta generó una “dependencia psicológica” y que fallaron los mecanismos de seguridad. “ChatGPT mató a mi hijo”, declaró la madre, Maria Raine, trabajadora social y terapeuta.

Por su parte, OpenAI expresó condolencias y afirmó que el sistema cuenta con salvaguardas, aunque reconoció que su efectividad disminuye en diálogos prolongados. La empresa aseguró que continúa trabajando en reforzar la protección para usuarios adolescentes.

Expertos consultados señalaron que los chatbots no reemplazan a profesionales de la salud y advirtieron sobre la dificultad legal de atribuir responsabilidad directa en casos de suicidio. Mientras tanto, los padres de Adam crearon una fundación para concientizar sobre los riesgos de la tecnología en contextos de vulnerabilidad emocional.